Google potencial Lens con el reconocimiento de texto muestra nuevas herramientas para la comunicación inclusiva

Android Q es la próxima versión del sistema operativo móvil de Google y la compañía ha adelantado algunas de sus novedades en el marco de la conferencia anual de desarrolladores Google I/O relativas a la privacidad y su adaptación a las nuevas categorías de dispositivos.

Stephanie Cuthbertson, de Android, ha compartido las novedades en Android Q que girarán en torno a la innovación, la privacidad y la seguridad, y el bienestar del usuarios, como ha indicado en el escenario.

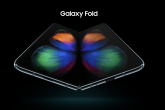

Android Q estará adaptado a las nuevas categorías de ‘smartphones’, es decir, los modelos plegables que las marcas ya han empezado a mostrar y los dispositivos con conectividad 5G.

Cuthbertson ha destacado la función ‘Screen continuity’, por la que traslada lo que en ese momento se ve en el modo ‘smartphone’ al modo tableta cuando el dispositivo se despliega. Y lo hace sin que haya interrupción.

Para procurar la conectividad 5G, que ofrece mayor velocidad y reduce la latencia, Google se ha asociado con más de 20 operadores para que Android Q lo soporte en los ‘smartphones’ compatibles desde el primer momento.

La tecnología ‘on-device machine learning’, de aprendizaje automático en el propio dispositivo, ha permitido desarrollar Live Caption, una herramienta que introduce subtítulos en los vídeos y archivos de audio que no los tienen, de forma automática y en tiempo real.

Con ‘On-device machine learning’ también se ha desarrollado Smart Reply, que se ha integrado en el sistema de notificaciones, desde donde sugiere respuestas. Ahora, además, es capaz de predecir la siguiente acción del usuario.

Privacidad y seguridad

Android Q introducirá más de 50 características y cambios de seguridad y privacidad, como ha señalado Cuthbertson. Uno de ellos, en Ajustes, recoge en un sitio específico las opciones de privacidad.

En este apartado se encuentra un nuevo control de Localización, que permite gestionar los datos sobre la localización que el usuario comparte con las aplicaciones, e introduce una nueva posibilidad, para compartir datos solamente mientras el usuario esté usando la ‘app’. Asimismo, enviará notificaciones sobre las ‘apps’ que acceden a la localización en segundo plano.

Además, Android Q permitirá actualizar los componentes más destacados del sistema mediante actualizaciones en segundo plano.

Bienestar

Android Q potenciará las herramientas de bienestar y gestión de uso de móvil. Para ello, introducirá el Modo ‘Focus’, que permitirá seleccionar la aplicaciones que más distraen al usuario y silenciarlas. Llegará a Android P y Q en otoño.

También con Android Q los padres podrán tener más control sobre el uso que sus hijos hacen de los ‘smartphones’ mediante la función Family Link, que enlaza los dispositivos con la aplicación de Bienestar. También introducirá la posibilidad de conceder tiempo extra a los niños para que usen las aplicaciones y de establecer tiempos límites específicos.

Google potencial Lens

Google ha potenciado las funciones de Lens con el reconocimiento de texto y de Duplex, la herramienta de reservas de servicios para el Asistente que ha dado el salto a la web, ya mostrado sus avances en la tecnología inclusiva con nuevas herramientas para que las personas con alguna discapacidad podrán comunicarse más fácilmente.

Este martes ha comenzado el evento anual de desarrolladores Google I/O 2019, en el que la compañía ha presentado en la ‘keynote’ de apertura las novedades que ha introducido en sus servicios.

La Cámara de Google se ha integrado en el buscador para acceder a información visual directamente desde los resultados de búsqueda. Al hacer una búsqueda, introduce un nuevo tipo de contenido en los resultados (vista en 3D), que permite ver el contenido de forma tridimensional o incluso superpuesto a la realidad.

Google Lens, asimismo, simplifica la búsqueda con solo apuntar con la cámara y con su nueva función, reconoce texto y amplía sus usos. Por ejemplo, muestra los platos más populares de un restaurante con solo apuntar al menú, donde aparecerán resaltados. Pero también permitirá comprobarlos en el buscador, y ver las imágenes a partir de las fotos y los comentarios de los usuarios.

PAra potenciar esta nueva función, Google está trabajando con distintos socios para que la nueva función de Lens haga que recetas o elementos de museos cobren vida en el ‘smartphones’.

Para los ‘smartphones’ de gmaa de entrada, desde el buscador, al abrir Lens, se puede emplear para traducir un texto al apuntar la cámara sobre él. Permite distintas opciones, como la traducción instantánea (sobrepone la traducción al texto original), búsqueda o incluso la lectura del texto que, además, resalta las palabras según las va leyendo en voz alta.

Asistente de Google

Google presentó en el evento Google I/O del año pasado Duplex, una herramienta para el Asistente de la compañía que realiza reservas telefónicas, manteniendo una conversación con el interlocutor.

Ahora, ha llevado Duplex a la web. Con ‘Duplex on the web’ cuando se lo solicita el usuario (por ejemplo, reservar un coche de determinado servicio), puede realizar una reserva de ese servicio online, seleccionando las distintas opciones en base a la información que recopila de otros servicios de Google.

Las mejoras del Asistente están enfocadas a potenciar la multitarea y a hacer más sencilla y natural la interacción. En este sentido, el Asistente permite abrir y navegar a través de las aplicaciones del móvil de forma instantánea y sin tener que decir ‘Hey, Google’ continuamente.

En cuando a la multitarea, el usuario puede dictar con la voz las acciones a realizar en un email o un chat: el mensaje que quiere enviar, la foto que quiere adjuntar, y solicitar información de otros servicios sin salir de la primera ‘app’.

Otra nueva función es ‘Picks for you’, que primero estará disponible con recetas, podcasts y eventos, cuando llegue en verano. El usuario pregunta por la cena, por ejemplo, y el Asistente le sugiere distintas recetas, y añade comentarios en base a la actividad previa del usuario: ‘ya has hecho esta hace poco’ o ‘te encanta la comida portuguesa’.

La compañía también ha ampliado las capacidades de comprensión del Asistente con referencias personales para que entienda mejor el mundo. Esto permite preguntar cosas de forma más natural, como “enséñame fotos de mis sobrinos”.

En el coche, la interacción con el Asistente está enfocada a mejorar la experiencia de conducción con el Modo Conducción, que llegará en verano. Sin salir de la pantalla de navegación de Maps, el usuario puede pedir al asistente que reproduzca determinada música, o que rechace una llamada entrante, entre otras acciones.

Otra función permite detener las alarmas son solo decir ‘Stop’ (para), sin tener que activar el comando con ‘Hey, Google’.

Privacidad y seguridad

“Creemos que la privacidad y la seguridad son para todos, no solo para unos pocos”, ha asegurado el CEO de Google, Sundar Pichai, en el escenario. En este sentido, la compañía ha mostrado los avances que realiza con la tecnología TCAV, para que evitar el sesgo en la inteligencia artificial.

En lo relativo a la privacidad, la compañía ha unificado las distintas opciones de configuración en un mismo lugar, en la cuenta de Google, para facilitar el acceso a las mismas y la gestión de la información que el usuario comparte.

La semana pasada, asimismo, Google presentó una nueva opción, que permite establecer la eliminación de los datos del historial de actividad o de la localización de forma automática al establecer un periodo de tiempo. En Maps, al pinchar en la foto de perfil, se puede acceder al modo incógnito, que evita que la actividad de búsqueda se quede registrada.

Recientemente, Google ha avanzado en la verificación en dos pasos al convertir el ‘smartphone’ Android en llave de seguridad. Y para mantener la información más segura, ha mostrado el aprendizaje colaborativo (Federated Learning).

El aprendizaje colaborativo es una aproximación de recogida de datos por la que el sistema aprende de la información de los distintos móviles, que resumen el aprendizaje en una actualización enfocada, que es lo que envía a los ‘smartphones’. Es decir, los datos no salen del terminal en ningún momento.

Herramientas para la comunicación inclusiva

Google trabaja también por hacer de sus servicios más inclusivos, que puedan ser usados por todos. Por ello, también ha mostrado ejemplos de herramientas que permiten a las personas sordas o con discapacidad auditiva leer en pantalla lo que otra persona dice cuando le habla, en tiempo real, con Live Transcribe. O leer subtítulos automáticos en los vídeos con Live Caption.

Para las personas que no pueden hablar o tienen dificultad para hacerlo, la herramienta Live Relay permite responder llamadas a través de un asistente que lee en voz alta las respuestas que el usuario escribe, facilitando la comunicación.

Texto y foto: DPA